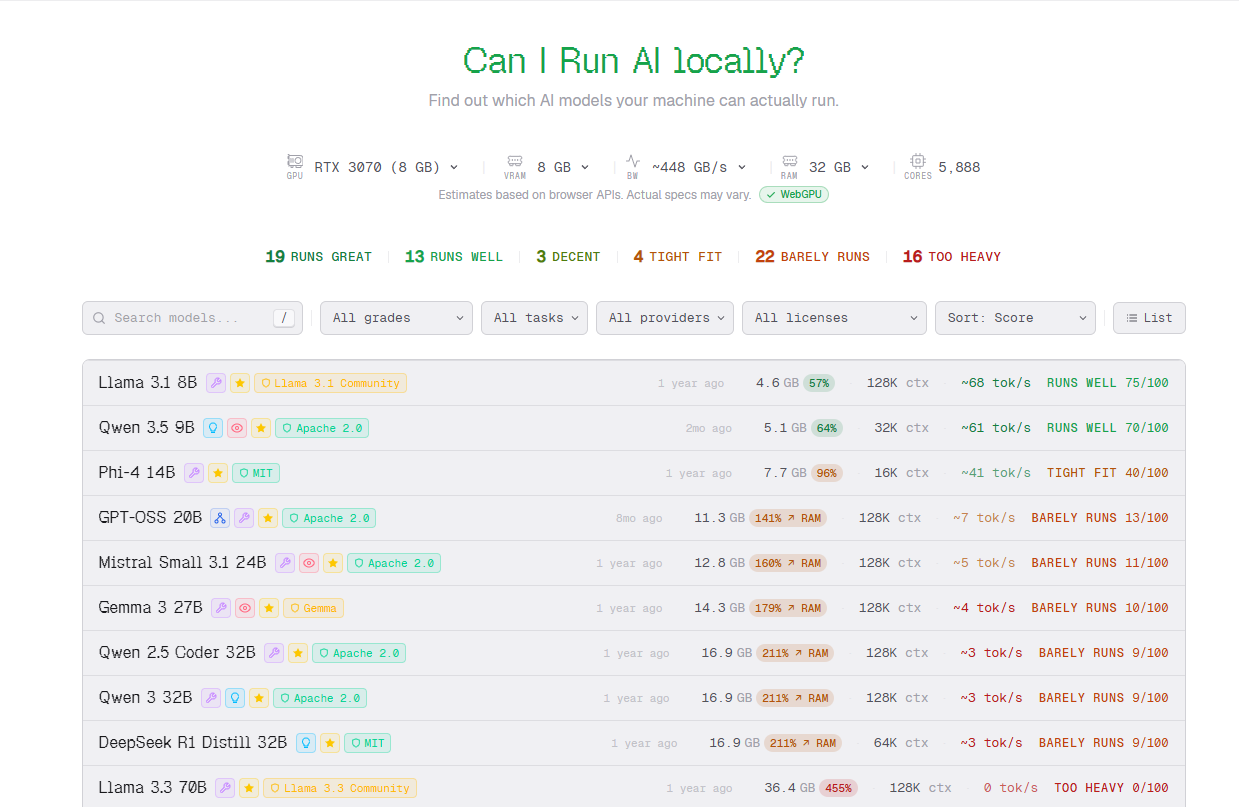

该网站可以检测你的电脑能本地运行哪些 AI 大模型。

它能自动识别你电脑的 GPU、显存等硬件信息,然后用不同颜色标注出哪些模型可以流畅运行(绿色)、哪些运行吃力(红色),还会显示模型的运行速度(如每秒多少 token),帮助你快速了解自己的设备能驾驭哪些 AI 模型,比如小编的电脑,用 RTX 3070 跑 DeepSeek 7B 模型很轻松,但跑 32B 的模型就会很吃力。

无需下载,不用折腾,打开浏览器就能测。一键扫描你的硬件配置,智能匹配 Llama、Mistral、Gemma 等主流大模型,告诉你哪些能跑、哪些跑不动、哪些跑起来体验最佳。

本地 AI 的第一道门槛,我们帮你跨过去。

打开网页自动检测硬件

支持 NVIDIA/AMD/Apple Silicon/Intel

覆盖 Llama 3, Qwen, Mistral, Gemma 等所有主流模型

告诉你 FP16/INT8/INT4 不同量化下的表现

纯前端检测,数据不上传,隐私安全。

请登录后发表评论

注册

停留在世界边缘,与之惜别